Não são só os humanos que sofrem alucinações. A Inteligência Artificial também, quando produz informações falsas, o que é considerado um grande problema na tecnologia LLM. Ao invés de assumir que não sabe, muitas vezes a IA simplesmente “inventa” nomes ou fatos, em uma espéciie de efeito colateral pela maneira como a tecnologia é treinada.

Por isso, essa semana o tradicional Dicionário de Cambridge escolheu o termo “alucinar” como a palavra do ano de 2023, e atualizou a palavra, ampliando seu significado para incluir essa doideira da IA.

Um teste clássico é dar ao ChatGPT premissas falsas para ver se ele as amplifica. Por exemplo pedindo provas de que os dinossauros construíram uma civilização. Houve um momento no início da tecnologia em que o ChatGPT respondia que existiam sim restos fósseis de ferramentas de dinossauros e que lgumas espécies até desenvolveram formas primitivas de arte, como gravuras em pedras.

Nova Definição de “Alucinar”

A nova definição de “alucinar” no Dicionário de Cambridge reflete como a IA está transformando o idioma inglês. Agora, além de seu significado original, “alucinar” também se refere à capacidade de um sistema de inteligência artificial (definido como um sistema computacional com algumas qualidades do cérebro humano, como a capacidade de produzir linguagem de forma que pareça humana) de gerar informações falsas.

“Quando uma inteligência artificial alucina, significa que ela produziu informações falsas.”

Esta evolução na linguagem é um reflexo direto do impacto crescente da IA no cotidiano. A entrada no dicionário inclui dois exemplos para esclarecer o conceito:

- “Modelos de linguagem de grande escala (LLMs) são notórios por alucinarem — gerando respostas completamente falsas, muitas vezes suportadas por citações fictícias.”

- “A versão mais recente do chatbot está muito melhorada, mas ainda assim pode alucinar fatos.”

Os Riscos das “Alucinações” da IA

Enquanto a Cambridge Dictionary acolhe essa nova definição, há preocupações crescentes sobre as implicações das “alucinações” da IA. Por exemplo, o ChatGPT pode fornecer conselhos médicos perigosos, e analistas de segurança temem que as alucinações da IA possam levar ao desenvolvimento de código malicioso.

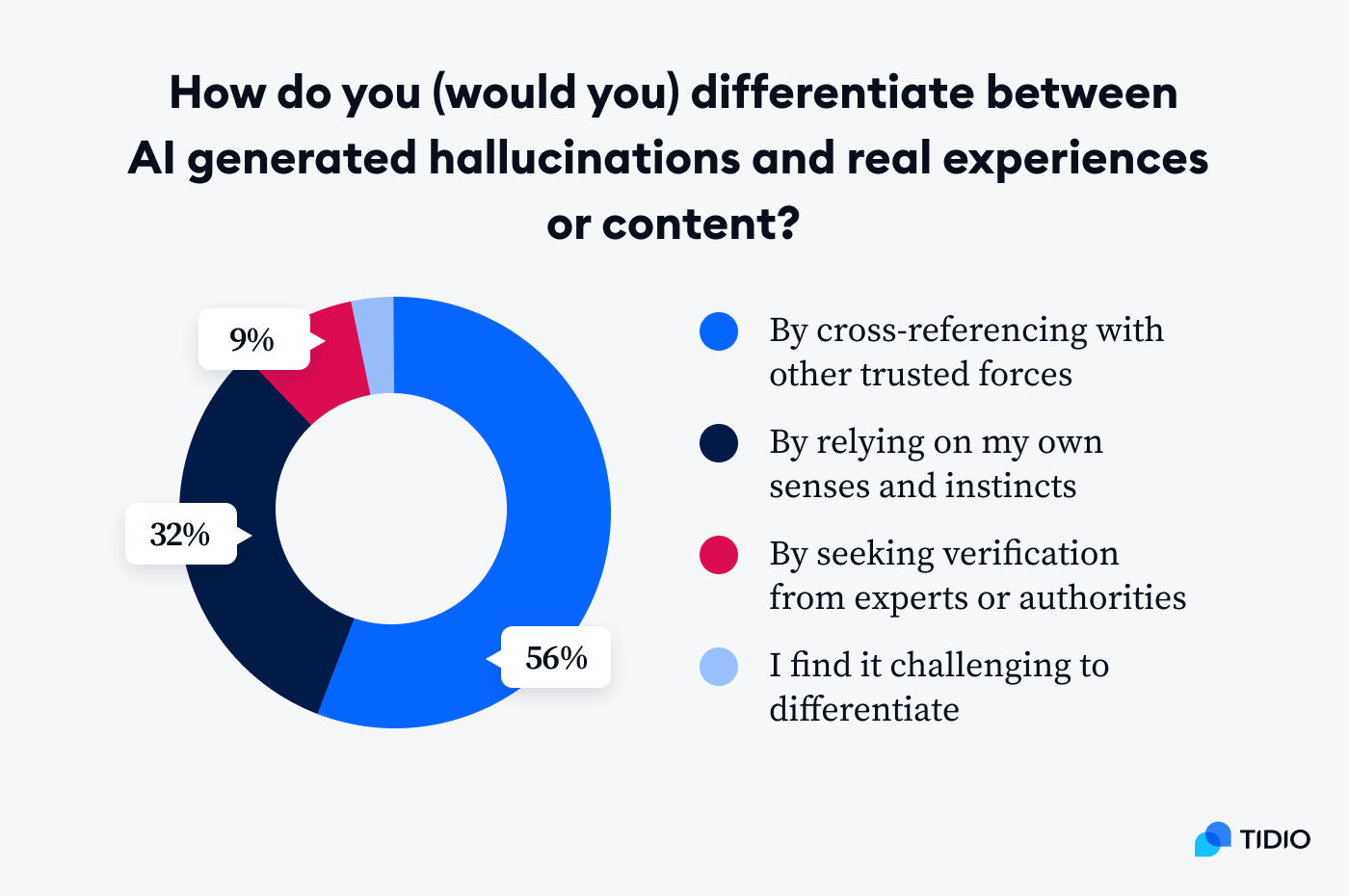

Gerenciar a tendência das ferramentas de IA gerativa para alucinar é crucial para manter a confiança dos usuários. Wendalyn Nichols, gerente de publicação do livro, enfatiza a importância dos especialistas humanos no rastreamento e captura de mudanças na linguagem, mantendo o Dicionário de Cambridge como uma fonte confiável de informações sobre novas palavras e significados que as ferramentas de IA voltadas para o público ainda não aprenderam.

A Segunda Influência Linguística da IA

Além de redefinir “alucinar”, os lexicógrafos adicionaram várias definições relacionadas à inteligência artificial no Dicionário de Cambridge durante 2023, incluindo modelo de linguagem de grande escala (LLM), IA gerativa (GenAI) e GPT. Com o ritmo atual de desenvolvimento da tecnologia, o impacto nos dicionários de 2024 pode ser ainda mais profundo.

Com a explosão contínua da IA gerativa, não seria surpreendente se a própria inteligência artificial inventasse a próxima palavra do ano.