A foto de Kate Middleton e o futuro da integridade das imagens e da ética jornalística

A foto de Kate Middleton é um exemplo de camada adicional de complexidade e preocupação ética gerada pela IA no jornalismo.

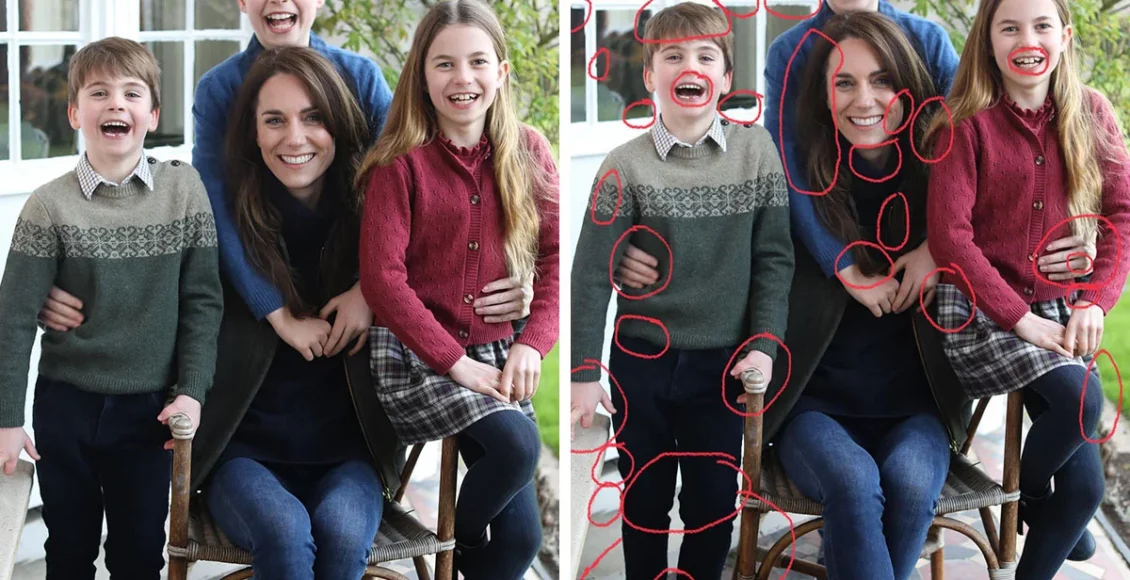

A retirada da imagem de Kate Middleton por três grandes agências de notícias – Associated Press (AP), Reuters e AFP – aponta para uma questão bastante relevante no campo do Direito Digital e da ética jornalística: a integridade das imagens e a responsabilidade da mídia em garantir sua autenticidade. Essa ação das agências segue um princípio fundamental no jornalismo de que as fotografias devem refletir a realidade sem alterações significativas que possam enganar o público ou distorcer os fatos.

As agências de notícias possuem políticas rígidas contra a manipulação digital de fotografias, que normalmente só permitem ajustes mínimos, como correção de cores ou remoção de poeira. Qualquer alteração além disso pode ser considerada uma violação das regras jornalísticas e éticas, pois modifica o conteúdo da imagem de maneira que não representa mais fielmente a realidade.

No caso da foto de Kate Middleton, a AP retirou a imagem citando “inconsistência no alinhamento da mão esquerda da Princesa Charlotte”. Isso sugere que a agência suspeitou de alguma forma de manipulação digital que foi contra suas diretrizes. Reuters e AFP seguiram o mesmo caminho após suas revisões pós-publicação.

É importante notar que, no contexto da comunicação pública e das mídias sociais, as figuras públicas e as instituições muitas vezes compartilham imagens que são cuidadosamente selecionadas ou mesmo editadas para transmitir uma mensagem específica. No entanto, quando tais imagens são redistribuídas por veículos de imprensa, a expectativa é de que elas sejam autênticas e não alteradas significativamente, mantendo a fidelidade aos eventos retratados.

A decisão das agências de retirar a foto também reflete a preocupação contínua com a integridade do jornalismo e a confiança do público, especialmente em uma era onde a manipulação de imagens é tecnicamente fácil e disseminada. Isso destaca a importância de uma abordagem rigorosa para validar e verificar as imagens antes de sua publicação, uma prática essencial para manter a credibilidade jornalística e informar o público de maneira precisa e ética.

Nos dias atuais, o uso da Inteligência Artificial (IA) na manipulação de imagens introduz uma camada adicional de complexidade e preocupação ética, especialmente no contexto de figuras públicas e da disseminação de informações. A tecnologia de IA, como os softwares de edição de fotos avançados e os deepfakes, permite criar e alterar imagens com um nível de realismo antes inatingível. Esta capacidade traz consigo questões significativas relacionadas à ética, à privacidade e à autenticidade da informação.

Questões Éticas e Impacto na Sociedade

Autenticidade e Confiança: A capacidade de alterar imagens de forma realista pode minar a confiança do público na veracidade das informações. No caso de figuras públicas como Kate Middleton, a manipulação de imagens pode distorcer a percepção pública e impactar sua imagem e reputação.

Consentimento e Privacidade: O uso de IA para alterar ou criar imagens de pessoas sem o seu consentimento levanta sérias questões de privacidade. Isso é particularmente preocupante no caso de figuras públicas, onde tais imagens podem ser usadas para propósitos difamatórios ou enganosos.

Impacto Social e Político: Manipulações de imagem podem ter um impacto significativo no discurso público e político. Imagens falsas ou manipuladas podem ser usadas para influenciar a opinião pública ou desacreditar indivíduos, o que é particularmente perigoso em contextos políticos ou sociais sensíveis.

Direito Digital e Responsabilidade: A legislação existente muitas vezes não acompanha o ritmo das inovações tecnológicas, criando um vazio legal no que diz respeito à utilização de IA em manipulações de imagem. Isso levanta questões sobre quem é responsável por imagens manipuladas e como as vítimas de tais manipulações podem buscar reparação.

Implicações para Figuras Públicas

No caso de figuras públicas, a situação é ainda mais delicada. Essas personalidades, frequentemente sob escrutínio público, podem encontrar suas imagens usadas ou manipuladas de maneiras que afetam a percepção pública e até mesmo questões legais relacionadas à difamação ou falsidade ideológica.

Gestão da Imagem Pública: A necessidade de gerenciar cuidadosamente a imagem pública se torna mais crítica, já que a disseminação de imagens manipuladas pode ocorrer rapidamente e ter efeitos duradouros.

Legislação e Políticas de Uso: Pode haver a necessidade de desenvolver legislações mais robustas e políticas de uso específicas para lidar com a manipulação de imagens, especialmente envolvendo figuras públicas.

Educação e Conscientização: Tanto figuras públicas quanto o público em geral precisam estar cientes das possibilidades e limitações das tecnologias de IA em manipulações de imagens. A educação sobre como identificar imagens potencialmente manipuladas é crucial.

Em conclusão, o uso de IA em manipulações de imagens representa um desafio significativo no que diz respeito à ética, à legalidade e à preservação da verdade e da autenticidade. É essencial um equilíbrio entre inovação tecnológica e considerações éticas e legais, garantindo que a tecnologia seja utilizada de maneira responsável e transparente, especialmente quando se trata de figuras públicas e da disseminação de informações na esfera pública.

Alexander Coelho – sócio do Godke Advogados, advogado especializado em Direito Digital e Proteção de Dados. CIPM (Certified Information Privacy Manager) pela IAPP (International Association of Privacy Professionals). É membro da Comissão de Privacidade e Proteção de Dados e Inteligência Artificial (IA) da OAB/São Paulo. Pós-graduando em Digital Services pela Faculdade de Direito de Lisboa (Portugal).